KI-Lebenszyklus: Das unterschätzte Thema

- vor 2 Tagen

- 3 Min. Lesezeit

Das volle Potenzial von Künstlicher Intelligenz zu nutzen, ist nicht einfach. Es gilt, durch die Etablierung anpassungsfähiger, flexibler und vielfältiger Organisationsstrukturen Risiken zu meiden und Chancen zu nutzen. Das gelingt nicht jeder Organisation.

Und die künstliche Intelligenz ist kein statisches IT-System. Ein KI-System verändert sein Verhalten durch neue Daten, geänderte Einsatzbedingungen, Nutzerinteraktionen und technische Anpassungen kontinuierlich. Deshalb endet die Verantwortung nicht mit dem Go-live. Unternehmen benötigen eine dauerhafte Steuerung über den gesamten Lebenszyklus der KI.

Gerade im Hinblick auf die EU AI Act, Informationssicherheit und den wirtschaftlich erfolgreichen Einsatz von KI werden daher in einem sich immer weiterbewegenden System die Governance, Risikomanagement und organisatorische Verantwortlichkeiten über den ganzen Lebenszyklus zu zentralen Erfolgsfaktoren. Die Zusammenhänge stellen wir in diesem Beitrag dar.

Warum der Lebenszyklus von KI-Systemen wichtig ist

KI-Systeme müssen während ihrer gesamten Nutzungsdauer überwacht, bewertet und angepasst werden. Ein Modell kann heute zuverlässig arbeiten und morgen durch veränderte Daten oder Prozesse an Qualität verlieren.

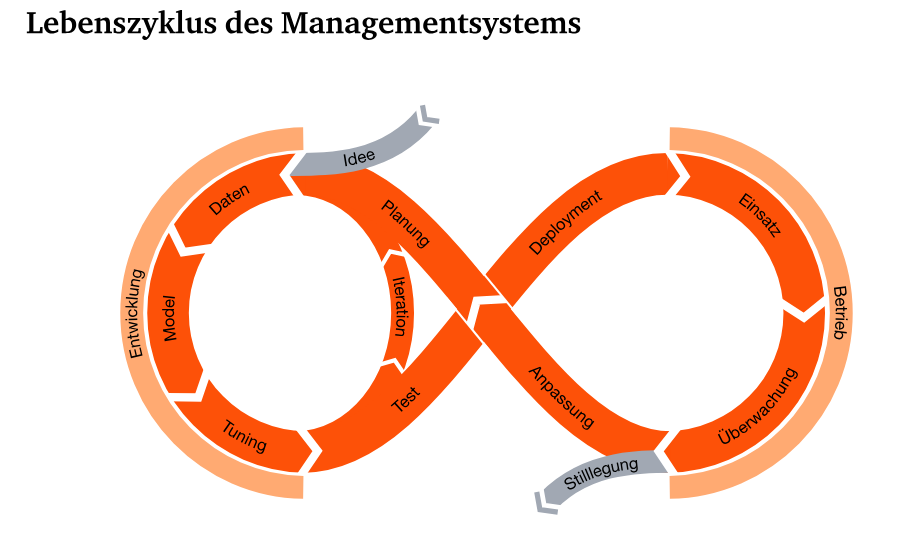

Bildquelle: PWC Legal

Typische Risiken im laufenden Betrieb sind:

Modell-Drift und Qualitätsverlust,

fehlerhafte oder verzerrte Ergebnisse,

Bias- und Diskriminierungseffekte,

Sicherheitslücken,

mangelnde Nachvollziehbarkeit,

regulatorische Verstöße,

sowie fehlende Transparenz gegenüber Kunden, Mitarbeitenden oder Behörden.

Deshalb reicht ein reines Entwicklungsprojekt nicht aus. KI benötigt einen strukturierten Lebenszyklus mit klaren Prozessen für:

Planung,

Entwicklung,

Freigabe,

Betrieb,

Monitoring,

Risikomanagement,

kontinuierliche Verbesserung

und kontrollierte Außerbetriebnahme.

Risikomanagement als zentrale Steuerungsfunktion

Ein professionelles KI-Risikomanagement ist aus dem Grund unverzichtbar. Risiken müssen nicht nur vor der Einführung bewertet, sondern fortlaufend überwacht und gesteuert werden. Dazu gehören unter anderem:

Identifikation technischer und organisatorischer Risiken,

Bewertung von Auswirkungen auf Menschen, Prozesse und Compliance,

Maßnahmen zur Risikobehandlung,

Überwachung von Änderungen und Abweichungen,

Dokumentation und Nachweisführung,

sowie Eskalations- und Freigabeprozesse.

In der Praxis betrifft dies nicht nur Hochrisiko-KI, sondern nahezu jede produktiv eingesetzte KI-Anwendung.

Organisation und Governance von KI

Neben der Technik entscheidet vor allem die Organisation über den erfolgreichen Einsatz von KI. Unternehmen benötigen klare Governance-Strukturen und definierte Verantwortlichkeiten. Dabei stellt sich häufig die Frage:

zentrale KI-Steuerung,

dezentrale Fachbereichslösungen,

oder ein hybrides Governance-Modell?

Zentrale Strukturen bieten Vorteile bei:

Compliance,

Standardisierung,

Informationssicherheit,

Risikomanagement und

Dokumentation.

Dezentrale KI-Nutzung ermöglicht dagegen:

höhere Flexibilität,

schnellere Innovation,

und fachbereichsnahe Umsetzung.

In der Praxis etablieren viele Unternehmen daher ein hybrides Modell mit zentralen Governance-Vorgaben und dezentraler operativer Nutzung. Vor allem wichtig ist eine KI-freundliche Kultur, die offen für KI-Innovationen ist.

Wichtige organisatorische Themen sind insbesondere:

Rollen und Verantwortlichkeiten,

Freigabeprozesse,

KI-Kompetenzen,

Richtlinien und KI-Policies,

Lieferantensteuerung,

Datenschutz,

Auditierbarkeit

sowie kontinuierliche Schulungen.

ISO 42001 als Managementsystem für KI

Die ISO/IEC 42001 bietet - auch jenseits der Regulatorik - hierfür einen strukturierten Rahmen in Form eines Artificial Intelligence Management Systems (AIMS). Die Norm unterstützt Unternehmen dabei:

KI systematisch zu steuern,

Risiken zu kontrollieren,

Compliance-Anforderungen umzusetzen,

Verantwortlichkeiten festzulegen,

und den sicheren Betrieb von KI dauerhaft sicherzustellen.

Zu den zentralen Themen der ISO 42001 gehören:

KI-Governance,

Risikomanagement,

Transparenz,

Dokumentation,

menschliche Aufsicht,

Kompetenzmanagement,

Sicherheitsmaßnahmen,

kontinuierliche Verbesserung

und Lebenszyklussteuerung.

Die Norm betrachtet KI ausdrücklich nicht als Einzelprojekt, sondern als dauerhaft zu führenden organisatorischen Prozess.

Anforderungen der KI-Verordnung

Auch die EU AI Act folgt diesem Lebenszyklusansatz. Unternehmen müssen je nach Risikoklasse unter anderem:

Risiken bewerten,

Sicherheitsmaßnahmen etablieren,

Transparenz sicherstellen,

Dokumentationspflichten erfüllen,

menschliche Aufsicht gewährleisten

und KI-Kompetenzen nachweisen.

Besonders bei Hochrisiko-KI-Systemen stehen Nachvollziehbarkeit, Governance und kontinuierliche Kontrolle im Mittelpunkt. Die Anforderungen enden daher nicht mit der Einführung eines Systems, sondern gelten über die gesamte Nutzungsdauer hinweg.

NIST AI RMF als praktischer Ansatz

Je nach Situation und Eignung bietet auch das National Institute of Standards and Technology mit dem AI Risk Management Framework (AI RMF) ein praxisnahes Modell zur Steuerung von KI-Risiken. Die vier Kernbereiche sind Govern, Map, Measure und Manage, sie zeigen, dass erfolgreiche KI immer eine Kombination aus Technik, Governance und Risikomanagement erfordert.

Fazit

Ein KI-System benötigt heute mehr als nur Entwicklung und Implementierung. Erfolgreiche Unternehmen etablieren einen vollständigen KI-Lebenszyklus mit:

Governance,

Risikomanagement,

Compliance,

Sicherheitsmaßnahmen

und klaren organisatorischen Verantwortlichkeiten.

Nur so lassen sich Qualität, Transparenz, regulatorische Anforderungen und ein langfristig sicherer KI-Betrieb gewährleisten.

Der Lebenszyklus von KI-Systemen ist nicht nur ein technisches Thema – er ist die Grundlage für sichere, regelkonforme und wirtschaftlich erfolgreiche KI, die ISO 42001 kann einen wesentlichen Beitrag leisten!

Wir unterstützen Sie auf dem Weg zu einer KI-gesteuerten Organisation. Fordern Sie einen Termin an!